Para muchos equipos de comercio electrónico, el A/B testing es una parte habitual de la optimización. Se prueban dos variantes, se observa cuál convierte mejor y se implementa la ganadora. Listo.

En la práctica, el impacto de una prueba suele ser más amplio que el simple aumento o disminución de una sola métrica.

¿Qué ocurre si una prueba “gana” en conversión, pero el valor medio del pedido disminuye? ¿O si baja el número de productos por pedido? ¿Es realmente una mejora?

En este artículo mostramos por qué el A/B testing solo se vuelve verdaderamente valioso cuando se analiza más allá de una sola métrica, y por qué el AOV y el UPT son esenciales para interpretar correctamente los resultados.

El error más común en el A/B testing es optimizar basándose en suposiciones. Por ejemplo: hacer los filtros más visibles seguramente aumentará la conversión. Menos opciones facilitan la compra. Suena lógico, pero el comportamiento de los usuarios suele ser más complejo de lo que parece. Por eso se prueba.

El segundo error suele venir inmediatamente después: mirar únicamente la conversión.

La conversión indica cuántos visitantes compran, pero no cómo compran. Y ahí es donde suele encontrarse el verdadero impacto de una prueba.

Para evaluar correctamente los resultados de una prueba, es importante mirar más allá de la conversión. En la práctica, las siguientes métricas desempeñan un papel clave:

En conjunto, estas métricas muestran qué cambios se producen realmente en el comportamiento de compra de los visitantes.

En el primer A/B test se comparó una plantilla builder sin personalización con una variante en la que se aplicó personalización de forma activa. En la versión de prueba, los visitantes veían una cuadrícula de productos personalizada, basada en su comportamiento previo.

Los resultados fueron claramente positivos. No solo aumentó la conversión, sino también el valor medio del pedido (AOV), el número de productos por pedido (UPT) y los ingresos totales. Los visitantes completaron sus compras con mayor frecuencia y añadieron más productos al carrito.

Este A/B test demuestra que la personalización no solo influye en el comportamiento de compra, sino que también contribuye directamente a un mayor valor comercial.

Al analizar varios KPI en conjunto, se hace evidente que la incorporación de la personalización tiene un impacto medible en el resultado global.

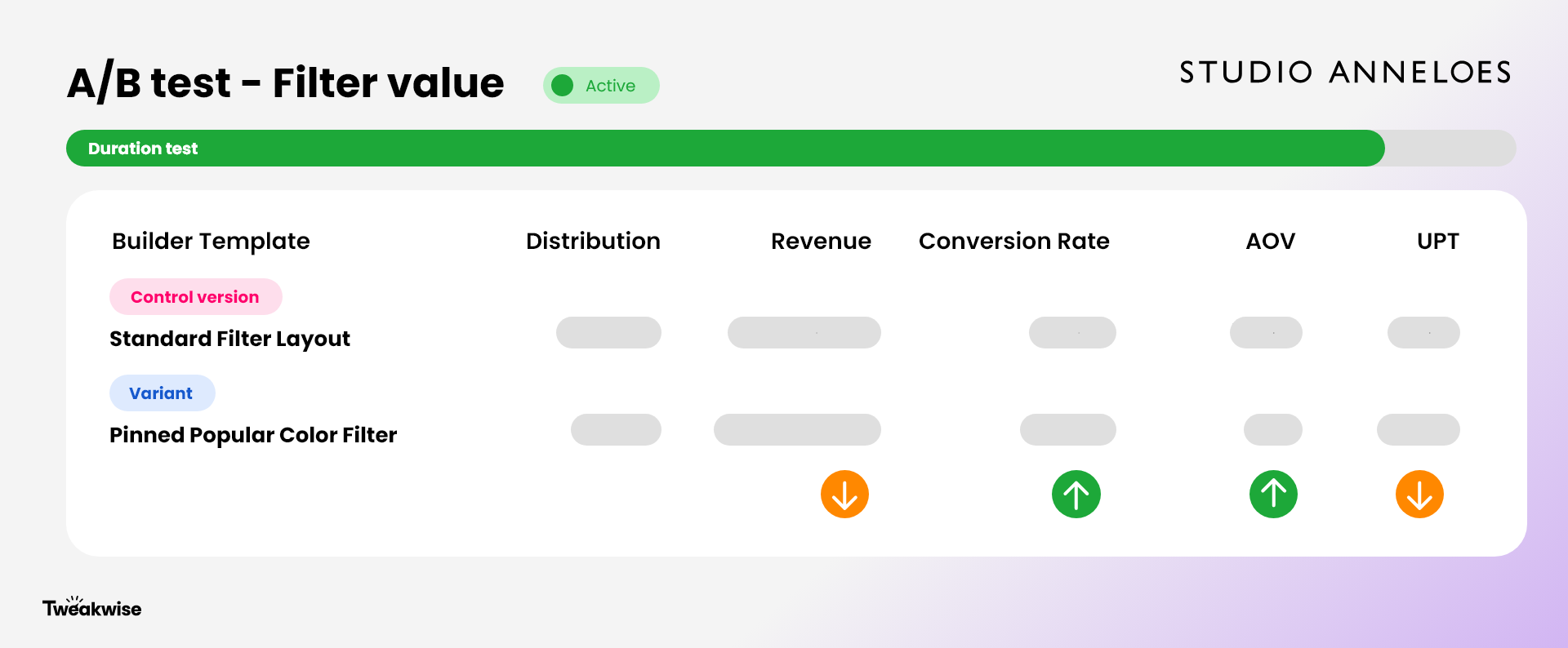

El segundo A/B test se centró en mostrar valores de filtros populares en posiciones fijas dentro de la plantilla builder. Por ejemplo, hacer visible de inmediato un color elegido con frecuencia.

También en este A/B test aumentó la conversión. Sin embargo, se observó que los visitantes desplazaban menos la página y comparaban menos productos. Esto dio lugar a un UPT más bajo y, finalmente, a una reducción de los ingresos.

Este A/B test subraya que un mayor porcentaje de conversión no significa automáticamente que un cambio sea mejor para el resultado global. Solo al incluir varios KPI se puede determinar si un A/B test contribuye realmente al objetivo de negocio.

Un A/B test no es automáticamente exitoso solo porque la conversión aumenta.

Una prueba solo es valiosa cuando se comprende:

En algunos casos, una mayor conversión con un AOV más bajo puede ser aceptable, por ejemplo con productos de entrada o en estrategias de liquidación de stock. En otros casos, el objetivo es aumentar el valor por pedido o por cliente.

Por eso el A/B testing no trata de ganar, sino de entender.C’est pourquoi l’A/B testing ne consiste pas à gagner, mais à comprendre.

Un buen A/B testing no consiste en ganar una prueba, sino en mejorar el resultado global. Es un proceso continuo de medir, interpretar y ajustar basándose en varios KPI.

Los casos en Studio Anneloes demuestran que las optimizaciones solo son realmente valiosas cuando contribuyen a los ingresos, al valor medio del pedido y al comportamiento de compra de forma conjunta.

Al mirar más allá de la conversión e integrar de manera estructural el AOV, el UPT y los ingresos, no se optimiza en función de métricas aisladas, sino en función de un crecimiento sostenible.

Esa es la diferencia entre probar para ganar y probar para crecer.