Pour de nombreuses équipes e-commerce, l’A/B testing fait partie intégrante de l’optimisation. Vous testez deux variantes, vous regardez laquelle convertit le mieux et vous déployez la gagnante.

En pratique, l’impact d’un test est souvent plus large que la simple hausse ou baisse d’un seul indicateur.

Que se passe-t-il si un test “gagne” en termes de conversion, alors que la valeur moyenne des commandes diminue ? Ou que le nombre de produits par commande baisse ? Est-ce vraiment une amélioration ?

Dans cet article, nous expliquons pourquoi l’A/B testing ne devient réellement pertinent que lorsque l’on regarde au-delà d’un seul indicateur, et pourquoi l’AOV et l’UPT sont indispensables pour interpréter correctement les résultats.

L’erreur la plus fréquente en A/B testing consiste à optimiser sur la base d’hypothèses. Par exemple : des filtres plus visibles augmenteront sûrement la conversion. Moins de choix facilitent l’achat. Cela semble logique, mais le comportement des visiteurs est souvent plus complexe qu’on ne l’imagine. C’est pourquoi on teste.

Le deuxième piège suit souvent immédiatement : ne regarder que la conversion.

Le taux de conversion indique combien de visiteurs achètent, mais pas comment ils achètent. Et c’est souvent là que se situe l’impact réel d’un test.

Pour évaluer correctement les résultats d’un test, il est essentiel d’aller au-delà du taux de conversion. En pratique, les indicateurs suivants jouent un rôle clé :

Ensemble, ces indicateurs montrent ce qui change réellement dans le comportement d’achat des visiteurs.

Dans le premier A/B test, un template builder sans personnalisation a été comparé à une variante intégrant activement la personnalisation. Dans la version test, les visiteurs voyaient une grille de produits personnalisée, adaptée à leur comportement précédent.

Les résultats ont été clairement positifs. Non seulement le taux de conversion a augmenté, mais aussi la valeur moyenne des commandes (AOV), le nombre de produits par commande (UPT) et le chiffre d’affaires total. Les visiteurs ont finalisé leurs achats plus fréquemment et ajouté davantage de produits à leur panier.

Cet A/B test montre que la personnalisation influence non seulement le comportement d’achat, mais contribue également directement à une valeur commerciale plus élevée.

En analysant plusieurs KPI conjointement, on constate que l’ajout de personnalisation a un impact mesurable sur le résultat global.

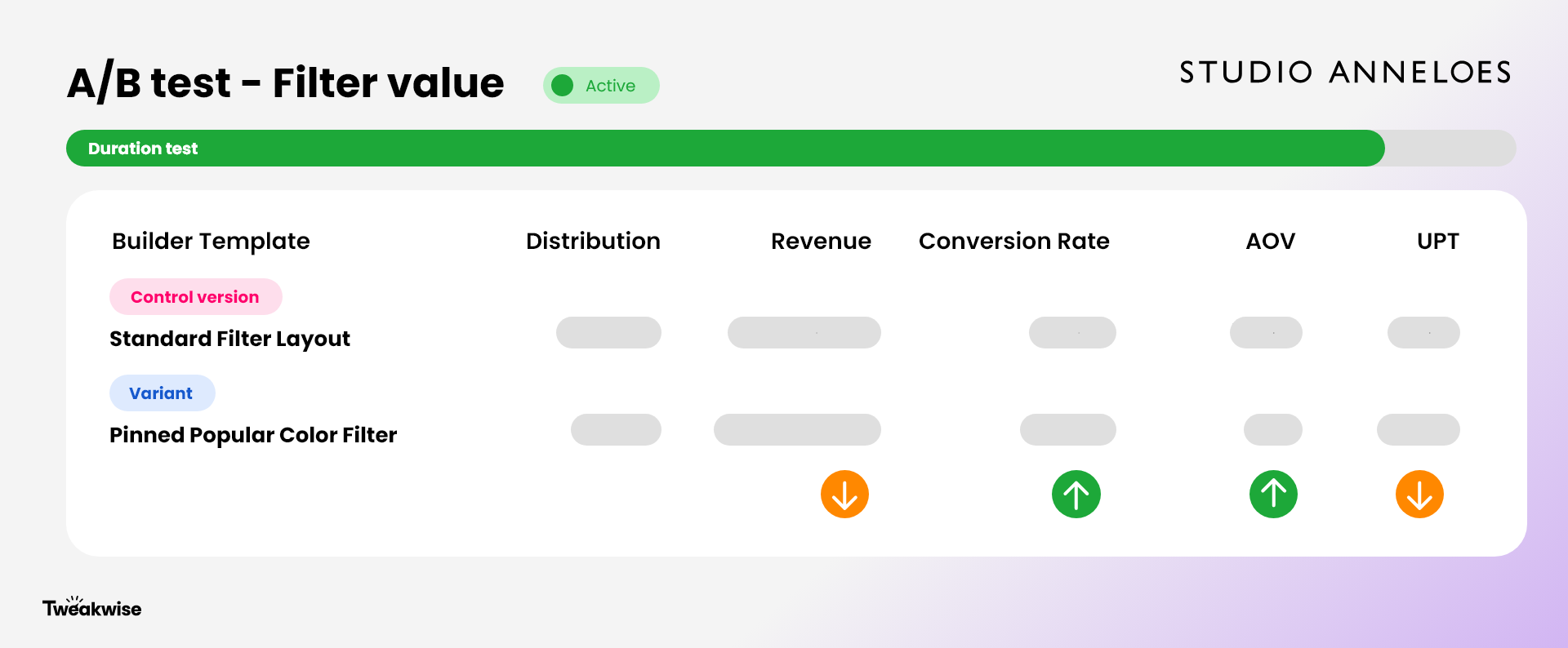

Le deuxième A/B test portait sur l’affichage de valeurs de filtres populaires à des positions fixes dans le template builder. Par exemple, une couleur fréquemment choisie était rendue immédiatement visible.

Dans cet A/B test également, le taux de conversion a augmenté. Toutefois, il est apparu que les visiteurs faisaient moins défiler la page et comparaient moins de produits. Cela a entraîné une baisse de l’UPT et, finalement, une diminution du chiffre d’affaires.

Cet A/B test souligne qu’une augmentation du taux de conversion ne signifie pas automatiquement qu’une modification est meilleure pour le résultat global. Ce n’est qu’en prenant en compte plusieurs KPI que l’on peut déterminer si un A/B test contribue réellement à l’objectif commercial visé.

Un A/B test n’est pas automatiquement réussi simplement parce que le taux de conversion augmente.

Un test devient réellement pertinent lorsque l’on comprend :

Parfois, une hausse du taux de conversion avec une baisse de l’AOV peut être acceptable, par exemple pour des produits d’entrée de gamme ou des opérations de déstockage. Dans d’autres cas, l’objectif est d’augmenter la valeur par commande ou par client.

C’est pourquoi l’A/B testing ne consiste pas à gagner, mais à comprendre.

Un A/B testing efficace ne consiste pas à gagner un test, mais à améliorer le résultat global. C’est un processus continu de mesure, d’interprétation et d’ajustement sur la base de plusieurs KPI.

Les cas chez Studio Anneloes montrent que les optimisations ne deviennent réellement pertinentes que lorsqu’elles contribuent au chiffre d’affaires, à la valeur moyenne des commandes et au comportement d’achat de manière cohérente.

En regardant au-delà du taux de conversion et en intégrant systématiquement l’AOV, l’UPT et le chiffre d’affaires, vous ne pilotez pas sur des indicateurs isolés, mais sur une croissance durable.

C’est la différence entre tester pour gagner et tester pour grandir.