För många e-handelsteam är A/B-testning en självklar del av optimeringen. Du testar två varianter, ser vilken som konverterar bäst och rullar ut vinnaren. Klart.

I praktiken visar det sig ofta att effekten av ett test är bredare än bara ökningen eller minskningen av en enda mätpunkt.

Vad händer om ett test “vinner” på konvertering, samtidigt som det genomsnittliga ordervärdet sjunker? Eller om antalet produkter per beställning minskar? Är det verkligen en förbättring?

I den här bloggen visar vi varför A/B-testning först blir värdefull när du tittar bortom en enskild mätpunkt, och varför AOV och UPT är avgörande när testresultat ska tolkas.

Det vanligaste misstaget inom A/B-testning är att optimera utifrån antaganden. Till exempel: mer synliga filter leder säkert till högre konvertering. Färre val gör det enklare att köpa. Det låter logiskt, men besökares beteende är ofta mer komplext än man tror. Därför testar du.

Den andra fallgropen kommer ofta direkt efter: att bara titta på konvertering.

Konvertering säger något om hur många besökare som köper, men inte om hur de köper. Och det är just där den verkliga effekten av ett test ofta finns.

För att korrekt utvärdera testresultat är det viktigt att titta bortom konvertering. I praktiken spelar följande mätetal en avgörande roll:

Tillsammans visar dessa siffror vad som faktiskt förändras i besökarnas köpbeteende.

I det första A/B-testet jämfördes en builder-mall utan personalisering med en variant där personalisering aktivt användes. I testvarianten visades besökarna ett personaliserat produktgrid, anpassat efter deras tidigare beteende.

Resultaten var tydligt positiva. Inte bara ökade konverteringen, även det genomsnittliga ordervärdet (AOV), antalet produkter per beställning (UPT) och den totala omsättningen steg. Besökare slutförde sina köp oftare och lade samtidigt fler produkter i varukorgen.

Detta A/B-test visar att personalisering inte bara påverkar köpbeteendet, utan också direkt bidrar till högre kommersiellt värde.

Genom att analysera flera KPI:er i relation till varandra blir det tydligt hur införandet av personalisering kan ha en mätbar effekt på det totala resultatet.

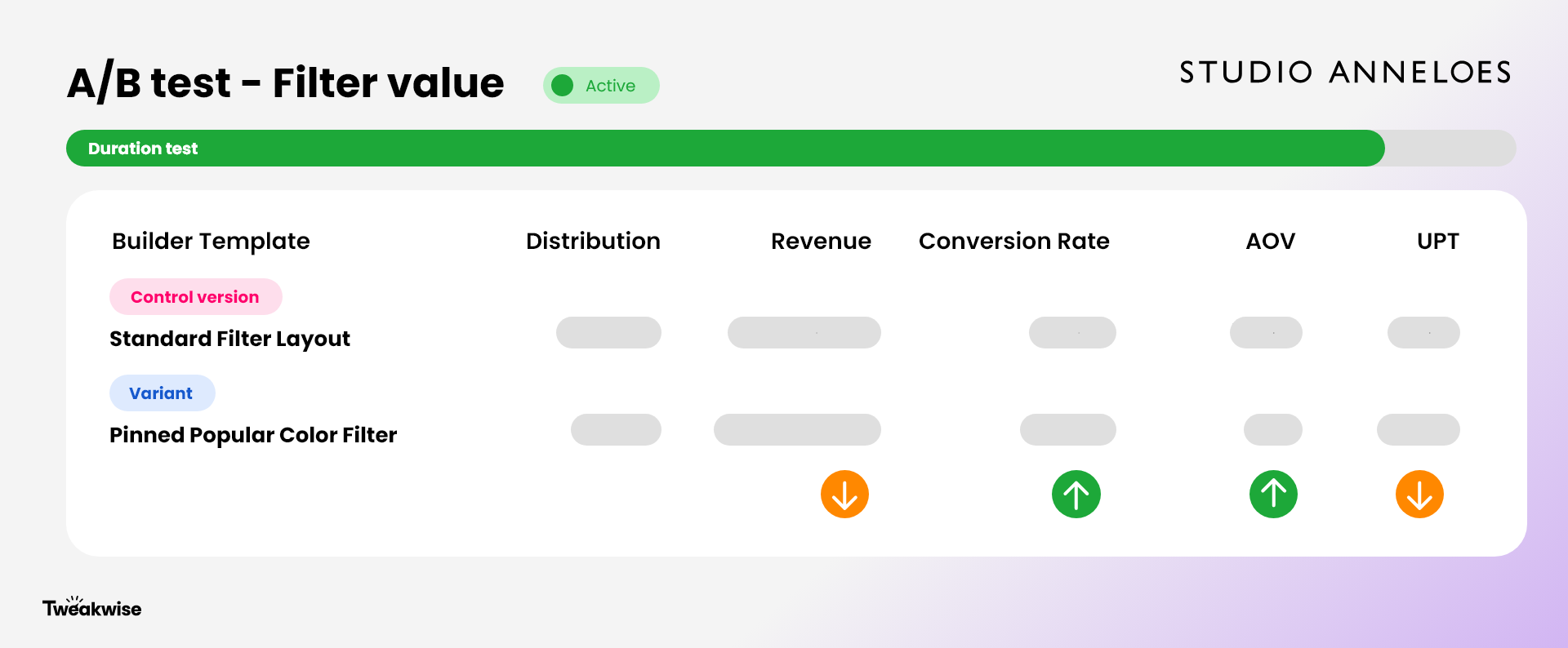

Det andra A/B-testet fokuserade på att visa populära filtervärden på fasta positioner i builder-mallen. Till exempel att en ofta vald färg görs direkt synlig.

Även i detta A/B-test ökade konverteringen. Samtidigt kunde man se att besökare scrollade mindre och jämförde färre produkter. Detta resulterade i en lägre UPT och i slutändan en lägre omsättning.

Detta A/B-test understryker att en högre konvertering inte automatiskt betyder att en förändring är bättre för helhetsresultatet. Genom att inkludera flera KPI:er blir det tydligt om ett A/B-test faktiskt bidrar till det önskade affärsmålet.

Ett A/B-test är inte automatiskt framgångsrikt bara för att konverteringen ökar.

Ett test blir värdefullt först när du förstår:

Ibland är en högre konvertering med lägre AOV acceptabelt, till exempel vid instegsprodukter eller lagerreducering. I andra fall vill du styra mot högre värde per beställning eller per kund.

Därför handlar A/B-testning inte om att vinna, utan om att förstå.

Bra A/B-testning handlar inte om att vinna ett test, utan om att förbättra helhetsresultatet. Det är en kontinuerlig process av att mäta, tolka och justera baserat på flera KPI:er.

Casen hos Studio Anneloes visar att optimeringar först blir verkligt värdefulla när de bidrar till omsättning, ordervärde och köpbeteende i samspel.

Genom att titta bortom konvertering och systematiskt inkludera AOV, UPT och omsättning styr du inte på isolerade mätetal, utan på hållbar tillväxt.

Det är skillnaden mellan att testa för att vinna och att testa för att växa.